具身智能的觉醒:当AI走出屏幕,开始动手改变世界¶

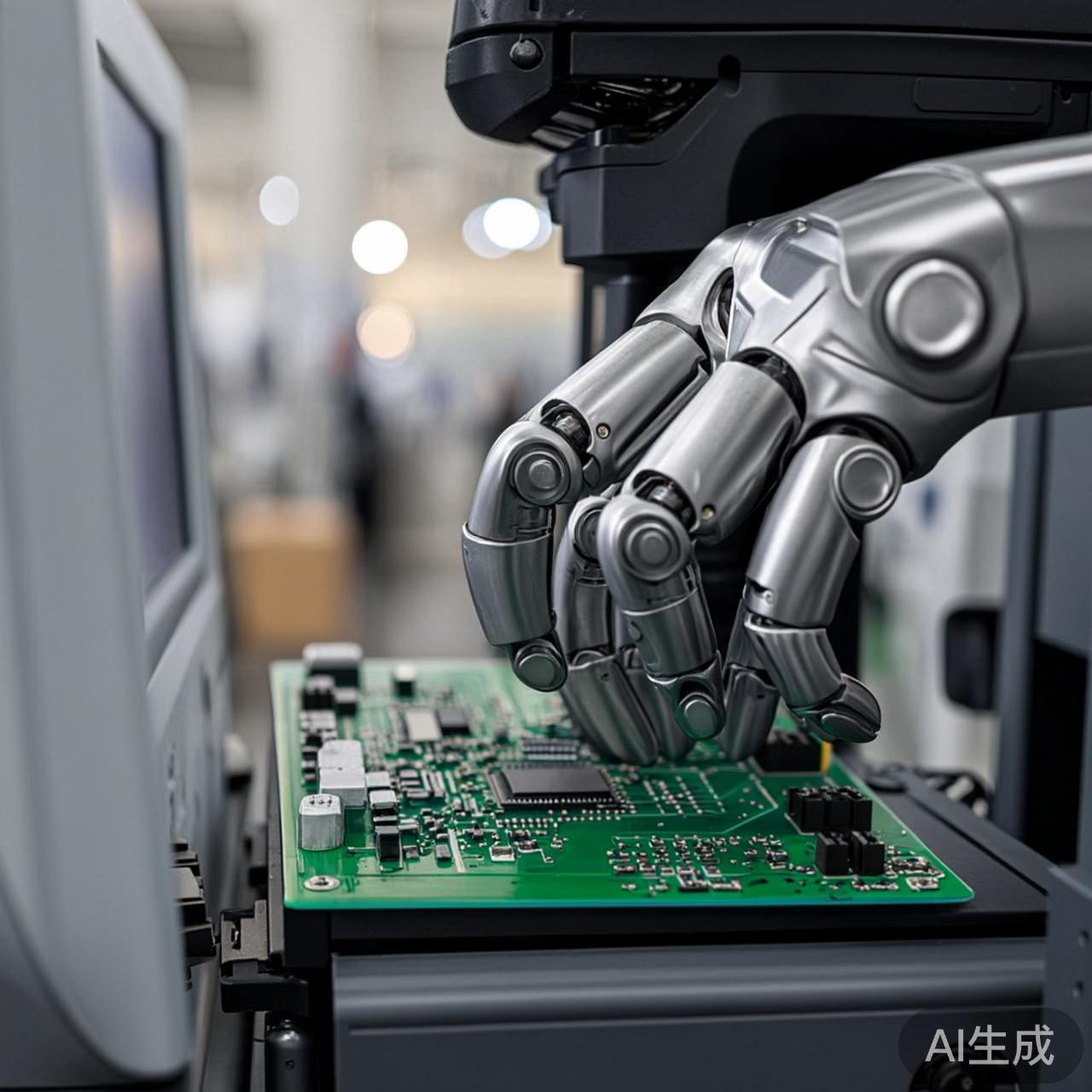

2026年春天,如果你走进深圳某电子厂的车间,可能会看到这样的场景:一台人形机器人正用五指灵巧地抓取电路板,放进检测设备,等结果出来后再分类码放。全程不需要人类干预。它不是科幻电影里的道具,而是宇树科技最新量产的G1人形机器人,单价已经压到了9.9万元——比很多工厂工人一年的工资还低。

这就是具身智能(Embodied AI)正在带来的变化。如果说过去三年的AI革命是"让机器学会思考",那2026年的主题就是"让机器学会动手"。大模型从聊天框里走出来,钻进机器人身体,开始在物理世界里干活了。

为什么是2026年?¶

时间回到2023年,ChatGPT引爆了语言智能。当时所有人都以为下一个爆点是更强的对话模型。但三年过去,纯文本AI的竞争已成红海——各家模型在基准测试上你追我赶,普通用户已经很难分辨GPT-5和Claude-4的差别。

真正的增量在哪里?答案是物理世界。

一组数据很直观:全球制造业产值超过16万亿美元,但自动化渗透率只有30%左右。服务业更惨,不到5%。而全球适龄劳动人口正在萎缩——日本、韩国、中国、德国,几乎所有制造业大国都在面临劳动力短缺。工信部数据显示,2025年中国制造业工人缺口已超过3000万。

大模型恰好补上了机器人最缺的一环:泛化能力。传统工业机器人只能在结构化环境里重复固定动作,换个产品型号就得重新编程。而搭载视觉-语言-动作(VLA)大模型的机器人,可以看着示范视频就学会新任务,还能理解自然语言指令。

"2026年就是机器人的GPT时刻。"Figure AI创始人Brett Adcock在最新采访中说。这家公司刚刚宣布其Figure 02机器人在宝马工厂连续运行了1000小时无事故。

三条技术路线,谁能跑通?¶

目前具身智能领域有三条主要技术路线在并行推进。

路线一:端到端VLA模型。 以Google DeepMind的RT系列、Figure的Helix为代表。思路很直接——输入视觉和语言,直接输出动作指令。优点是泛化能力强,看一遍就能学;缺点是需要海量训练数据,且动作精度还不够稳定。Figure 02在拧螺丝这类精细操作上,成功率约85%,离99.99%的工业要求还有距离。

路线二:分层架构。 以宇树科技、智元机器人为代表。底层用传统的运动控制算法(MPC+强化学习)保证稳定性,上层接大模型做语义理解和任务规划。这是更务实的路线——先让机器人能稳定走路、抓东西,再慢慢赋予它"聪明的大脑"。宇树G1能在碎石路、斜坡、甚至被踹一脚后保持平衡,靠的就是底层控制算法的积累。

路线三:仿真驱动。 以NVIDIA的Isaac Sim、Physical Intelligence的π0模型为代表。核心思路是在虚拟环境中训练,再迁移到真实世界(Sim-to-Real)。NVIDIA今年GTC上展示了Isaac GR00T——一个专门训练人形机器人的基础模型平台,在虚拟世界里让数千台机器人同时学习,相当于给AI开了一条"精神时光屋"。

三条路线不是互斥的。业内共识是最终会融合:仿真做大规模预训练,分层架构保证可靠性,端到端模型提升泛化能力。

中国军团:从追赶到定义赛道¶

具身智能领域有一个很有意思的现象:中国企业不再是跟随者,而是在定义产品形态。

宇树科技的人形机器人出货量全球第一,单价不到波士顿动力Atlas的十分之一。智元机器人的"远征A2"已经在比亚迪工厂里搬运物料超过6个月。优必选的Walker S拿到了蔚来汽车的批量订单。小米的CyberOne虽然还没开卖,但在发布会上递水杯那段演示,让所有人看到了消费级人形机器人的可能性。

为什么中国企业这么快?三个因素:

供应链优势。 人形机器人需要谐波减速器、力矩传感器、空心杯电机——这些精密零部件的全球产能,70%以上集中在长三角和珠三角。一个美国机器人创业公司从画图纸到拿到第一个原型机可能要6个月,深圳的公司3周就够了。

应用场景密集。 中国有全球最大的制造业产业集群,从东莞的电子厂到郑州的汽车产线,不缺愿意试用的客户。机器人公司不需要先烧钱教育市场,直接进厂干活就行。

政策驱动。 2025年底,工信部发布了《人形机器人创新发展指导意见》,明确将人形机器人列为"颠覆性技术",并设立了百亿级产业基金。各地方政府也在抢——北京、上海、深圳都把人形机器人列为重点招商方向。

当然,挑战也不小。核心芯片(高性能MCU、力矩传感器芯片)仍依赖进口,操作系统和仿真工具链基本被NVIDIA和ROS生态主导。但至少在整机和场景落地层面,中国已经站稳了第一梯队。

离走进家庭还有多远?¶

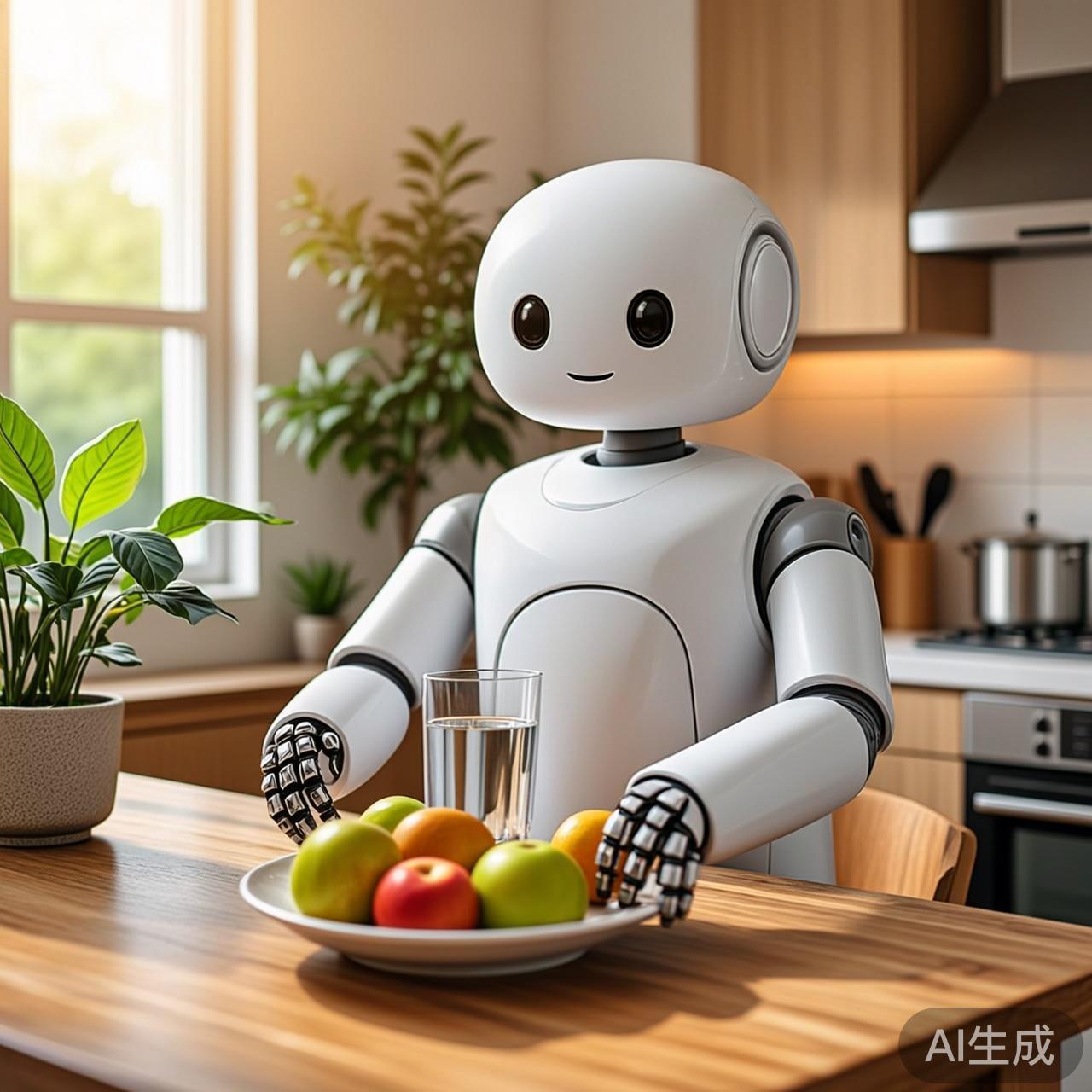

工厂之外,人们更关心的问题是:什么时候能买一台机器人回家做饭打扫?

现实是:还需要几年。不是技术做不到,而是成本和安全问题还没解决。

技术层面,Figure 02已经能叠衣服、收拾餐具、从冰箱里取饮料。宇树G1也能做简单的物品搬运。但这些演示都是在受控环境下完成的。真实的家庭环境有太多不可预测的变量——乱放的玩具、突然跑过的宠物、湿滑的地面。

安全是更大的问题。一台重50公斤、能举起20公斤重物的机器人,如果失控,可能造成严重伤害。目前还没有统一的家庭机器人安全标准,各国的法规也几乎是空白。

成本倒是下降得很快。宇树G1的9.9万定价已经接近消费级。业内预测,到2028年,家庭服务机器人的价格可能降到3-5万元区间——相当于一台高端家电。届时,先进入的可能是"半自主"形态:能做特定任务(洗碗、扫地、擦窗),但需要人类在关键决策上监督。

更大的图景:AI需要身体¶

具身智能的意义远不止"让机器人干活"。从AI研究的底层逻辑来看,身体是智能的必要条件。

这个观点最早来自认知科学——人类的抽象思维建立在感官经验之上。我们理解"重"是因为搬过东西,理解"远"是因为走过路。一个从未接触过物理世界的大模型,真的能"理解"物理规律吗?

Meta首席AI科学家Yann LeCun一直是具身智能的坚定支持者。他认为,要让AI达到人类水平的智能,必须让它在物理世界中学习。这也是为什么Meta在投入大量资源研究触觉传感器和机器人操控。

更深一层,具身智能可能是通向AGI的必经之路。文本可以描述这个世界,但只有身体才能真正感知和改变它。当一个AI不仅能说"我理解你的感受",还能在你难过时递上一杯热茶——那种体验将彻底改变人机关系。

2026年,具身智能正在从实验室走向产线。它的终极目标,是让AI从"有用的工具"变成"能干的伙伴"。这条路还很长,但第一块砖已经铺好了。

你认为机器人多久会进入普通家庭?欢迎留言讨论。